Data Center w erze AI: dlaczego w tych obiektach „dym” oznacza przestój i jak zmienia się podejście do bezpieczeństwa

Nowa era data center

Obecne data center to „fabryki danych”, budowane od podstaw jako osobne budynki lub kompleks budynków, ze skomplikowaną infrastrukturą i zintegrowanymi systemami utrzymaniowymi. Znaczący wzrost „nowych” data center zaczął się już okolicach 2015 r., i związany był z rozwojem Big Data i obliczeń chmurowych. Rosnące zapotrzebowanie na dane i usługi cyfrowe rosły bardzo szybko. Przykładowo, zużycie danych statystycznego użytkownika smartfona, wynosiło 1,9GB miesięcznie w 2016 r. , zaś w 2022 roku, zużycie to wzrosło ponad 5-krotnie

i wciąż rośnie.[i] Prognozy przewidują zużycie danych dochodzące nawet do 32 GB miesięcznie do 2029 r. [ii]

Jednak prawdziwy boom na zwiększoną moc obliczeniową i zapotrzebowanie na centra danych nastąpił w okolicach 2020 r, z powodu gwałtownego rozwoju AI. Od tego momentu, oprócz dostępu do streamingu, gier online, usług chmurowych, IoT, baz danych, e-commerce czy fintech- doszła sztuczna inteligencja, której sposób działania, szczególnie nowoczesnych modeli, jest nieliniowy. Oznacza to, że na ogromnych bazach danych wykonywanych jest równocześnie miliony obliczeń.Wymaga to zapotrzebowania na moc obliczeniową, a głównym motorem napędowym są karty graficzne (GPU), które odpowiadają średnio za 40% całkowitego poboru mocy[III]

Szacuje się, że obecnie ponad połowa mocy obliczeniowej DC przypada na AI[IV]. Raporty wskazują, że w Polsce prognozowana moc centrów danych w 2030 roku ma wzrosnąć do niemal 500 MW. Obecnie wynosi ona około 200 MW, w tym około 147 MW w samej Warszawie[V]. Większa moc obliczeniowa wymaga większej ilości energii. Przykładowo do 2030 r. globalne zużycie energii przez data center ma wynieść około 945 TWh rocznie, co odpowiada całkowitemu zużyciu energii elektrycznej w Japonii.[VI] Większa ilość mocy i energii to większa ilość wytwarzanego ciepła, co z kolei przekłada się na większe potrzeby chłodzenia, a w konsekwencji – na drastyczny wzrost gęstości obciążeń termicznych, które stają się bezpośrednim wyzwaniem dla systemów detekcji i tłumienia ognia.

Pożar w data center

Chociaż w ostatnich latach pożary w centrach danych są rzadkością, odpowiadają za jedne z najbardziej kosztownych przestojów w historii IT. Przykładowo: pożar, który wybuchł 26 września 2025 roku w centrum danych

w Korei Południowej, spowodował paraliż 647 usług cyfrowych[VII]- od masowej awarii setek systemów rządowych

i usług publicznych, przez zakłócenia w działaniu służb ratunkowych i administracji, aż po długotrwałą niedostępność kluczowych usług cyfrowych i utrudnienia w codziennym życiu obywateli. W Europie do największych zalicza się pożar centrum przetwarzania danych w Strasburgu w 2021 roku, który spowodował niedostępność usług dla około 120 000 klientów (ok. 3,6 mln stron internetowych[VIII]) oraz straty finansowe szacowane na ok. 105 mln EUR.[IX]

Pożar w tego typu obiektach to nie tylko straty finansowe, ale także ryzyko paraliżu usług cyfrowych

i administracyjnych, od których zależy stabilność funkcjonowania całego kraju. To sprawia, że taka „ fabryka danych” wymaga specjalnej ochrony, również w zakresie wentylacji pożarowej. Aby lepiej zrozumieć jej rolę, warto wspomnieć, jak zbudowane są współczesne centra danych i nakreślić ich specyfikę.

Ogólna specyfika techniczna data center i główne zagrożenia pożarowe

Współczesne centra przetwarzania danych to najczęściej obiekty budowane ze skomplikowaną infrastrukturą

i podsystemami utrzymaniowymi zintegrowanymi w jeden wspólnie działający system. Wykorzystuje się w nich rozwiązania takie jak:

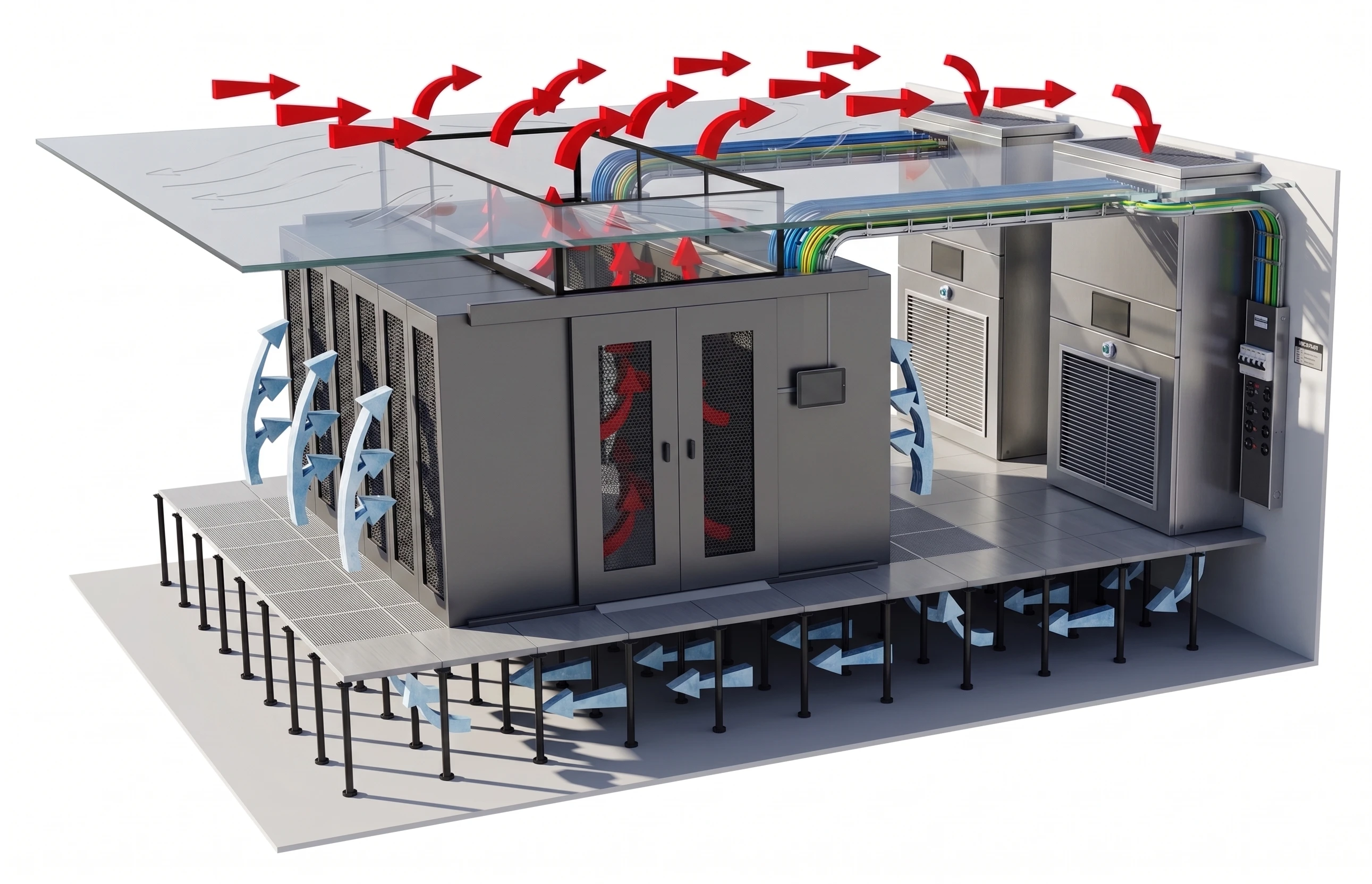

- podłoga techniczna, podwieszane sufity, kanały kablowe,

- strefy zimnego i gorącego powietrza tzw. hot/ cold aisle,

- zamykane korytarze,

- wydajne systemy wentylacyjne HVAC i chłodzenia- w tym CRAC/CRAH, czy coraz częściej spotykane chłodzenie cieczą,

- osobne pomieszczenia dla zasilaczy, baterii czy generatorów,

- separacje pożarowe i ściany o odpowiedniej klasie ogniowej,

- systemy gaszenia.

Fundamentem projektowania nowoczesnych centrów danych są normy i przepisy, obejmujące m.in. europejską normę EN-50600, krajowe ustawy i rozporządzenia, amerykańskie NFPA- 75/76 (które, choć nieobowiązkowe

w Polsce, zwiększają jakość i przewagę biznesową) oraz uzupełniające normy, jak EN-12101, zapewniające kompleksowe bezpieczeństwo, w tym pożarowe, czy EN-54 dot. systemów detekcji pożaru. W tym miejscu nie można również zapomnieć o normach środowiskowych czy dyrektywach efektywności energetycznej np. Dyrektywa Efektywności Energetycznej (EED).[X]

Natomiast do głównych zagrożeń pożarowych w data center możemy zaliczyć:

- awarie w obszarze systemów zasilania awaryjnego, przede wszystkim UPS (zasilaczy awaryjnych prądu) i baterii — szczególnie baterie litowo‑jonowe i duże banki akumulatorów. We wspomnianych wyżej pożarach za bezpośrednią przyczynę uznano awarię właśnie w tym obszarze,

- przeciążenia energetyczne- w przypadku data center obciążenia elektryczne są bardzo wysokie, a w przypadku DC dla AI mogą osiągać 40-50 kW, a nawet 80kW na jeden rack (szafę teleinformatyczną). Może to prowadzić do przeciążenia obwodów, nadmiernego nagrzewania kabli i topienia ich izolacji, ryzyka łuku elektrycznego,

a finalnie do zwarcia, zapłonu i pożaru. To jedno z najpoważniejszych zagrożeń w tego typu obiektach, - przeciążenia termiczne – rozgrzane elementy, np. karty GPU, generują ogromne ilości ciepła. Wewnątrz racku lub w jego otoczeniu tworzą się obszary o znacznie podwyższonej temperaturze – tzw. “hot spoty”, które mogą przegrzewać zasilacze, sekcje mocy oraz połączenia kablowe. To właśnie te komponenty, a nie same karty czy procesory, mogą ulec awarii termicznej i stać się faktycznym źródłem zwarcia, łuku elektrycznego i pożaru. Zwarcia na okablowaniu — zwłaszcza w podłodze technicznej i szafach zasilających,

- awarie systemów chłodzenia,

- błąd ludzki- np. podczas konfiguracji systemów czy pracach serwisowych, niewłaściwe przykręcenie złącza,

- rosnąca gęstość sprzętu — większe ryzyko przegrzań i awarii instalacji elektrycznych.

Ta mieszanka specyficznych zastosowań konstrukcyjnych i warunków panujących w takich obiektach ma wpływ na wspomniany w tytule dym. Dlaczego?

Dym w DC

„Pożary sprzętu elektrycznego i elektronicznego, w tym kabli i izolacji, generują duże ilości gęstego, toksycznego dymu, bogatego w cząstki i szkodliwe gazy chemiczne, które osadzają się na urządzeniach i zwiększają ryzyko ich uszkodzenia.”[XI] Dym obiekcie typu DC charakteryzuje się przede wszystkim: ciężkością, gęstością i wysoką toksycznością. To swoisty „koktajl” żrących substancji chemicznych, który zawieram.in. chlorowodór, cyjanowodór, dwutlenek siarki i dwutlenek azotu. Taki dym, nawet po ugaszeniu pożaru, pozostawia osad, a na powierzchniach metalowych pojawiają się mikro-wżery. W reakcji z wilgocią zawartą w powietrzu, pojawia się korozją, wpływając na usterki, a finalnie na degradację sprzętu.[XII] W szafach serwerowych może występować zjawisko „smoulderingu”, czyli spalania zachodzącego bez płomienia -z powolnym początkiem, z emisją mikroskopijnych cząsteczek dymu oraz brakiem natychmiastowej reakcji termicznej.

Dodatkowo, specyficzne warunki panujące wewnątrz obiektu oraz zastosowane rozwiązania konstrukcyjne

tj. podłoga techniczna, strefy zimnego i ciepłego powietrza, wydajna wentylacja, mogą powodować:

- rozrzedzenie dymu - wysoki przepływ powietrza przez systemy doprowadzające powietrze do schłodzenia, które jednocześnie rozrzedzają dym (pomimo coraz częściej stosowanej metody chłodzenia cieczą czy układów hybrydowych, łączących chłodzenie cieczą i powietrzem, chłodzenie powietrzem było stosowane w 43%[XIII] DC na świecie ( dane na 2023 r.),

- rozwarstwienie tzn. dym może nie unosić się równomiernie z powodu wahań temperatury, ciasno zabudowanych szaf, i ww. cyrkulacji powietrza.

Powyższe czynniki sprawiają, że dym staje się trudnym przeciwnikiem, zarówno do wykrycia, jak i pokonania,

co w przypadku jego wystąpienia może prowadzić do zagrożenia np. przestojem.

Dym w DC a przestój

Nadrzędnym celem funkcjonowania data center jest:

- utrzymanie ciągłości działania tzn. że infrastruktura IT pozostaje dostępna, nawet w przypadku awarii zewnętrznego zasilania czy katastrof,

- utrzymanie chłodzenia na bezpiecznym poziomie, co zapobiega uszkodzeniom kosztownego sprzętu. Branżowe źródła szacują , że koszt samego sprzętu IT to ok. 50-60%.[XIV] kosztów całego data center, co przy kwocie 61 mld $[XV] zainwestowanych w DC w 2025 r., obrazuje ogromną skalę kapitału narażonego na bezpośrednie ryzyko w przypadku wystąpienia pożaru,

- ciągłe działanie, zapewniające nieprzerwaną dostępność usług i aplikacji 24 godziny na dobę przez 7 dni w tygodniu.

Powyższe cele to wyzwanie, a przestój w data center może prowadzić do poważnych konsekwencji. W przypadku centrów danych najbardziej rozpoznawalnym standardem jest klasyfikacja TIER opracowana przez Uptime Institute, która bezpośrednio definiuje poziom dostępności infrastruktury. Nowoczesne data center projektowane są najczęściej w standardzie TIER III lub TIER IV, zapewniając wysoką niezawodność i minimalny czas przestoju. Aby zobrazować wysokie wymagania tego standardu- w najwyższej klasie tj. TIER IV- dostępność wymagana jest na poziomie 99,995% rocznie, co daje…niecałe 26 min przestoju rocznie! Oczywiście na tym poziomie stosuje się już rozwiązania typu np. 2N – pełna redundancja, i/lub Fault Tolerant, w którym system może działać mimo awarii dowolnego komponentu. Dodając do tego umowy biznesowe SLA poprzeczka związana z uniknięciem przestojów jest ustawiona bardzo wysoko. Dla firm każdy przestój może oznaczać również konsekwencje finansowe, o których była mowa na wstępie, czy chociażby straty wizerunkowe, co w przypadku największych graczy na rynku tzw. hiperskalerów jest nie do zaakceptowania.

Zmiana w podejściu do bezpieczeństwa

Podejście do kwestii bezpieczeństwa zmieniło się na przestrzeni lat. Początkowo głównym celem przy projektowaniu, budowie i utrzymaniu centrów danych była ochrona sprzętu. Sprzęt komputerowy kosztował więcej niż koszt utraty danych. W miarę rozwoju infrastruktury IT, zwiększenia jej dostępności oraz wzrostu znaczenia dostępności usług, podejście to ewoluowało w kierunku zapewnienia bezpieczeństwa procesów, czyli utrzymania ciągłości działania systemów i usług IT. W tym momencie to właśnie ochrona danych stała się priorytetem. Obecnie w centrach danych stosuje się połączenie obu podejść, gdzie równocześnie chroni się zarówno krytyczny sprzęt, jak i nieprzerwane funkcjonowanie procesów – można to określić mianem „mixu bezpieczeństwa sprzętu

i procesów”, który zapewnia zarówno ochronę fizyczną, jak i operacyjną centrum danych.

Rosnące wymagania rynku oraz coraz bardziej skomplikowane specyfikacje i wymagania dotyczące DC wymuszają dostosowanie rozwiązań przez producentów z różnych obszarów - od układów chłodzenia po systemy i wentylację pożarową.

W przypadku bezpieczeństwa pożarowego dobrze obrazuje to ewolucja systemów gaszenia. Pierwsze centra korzystały z klasycznych systemów wodnych, a głównym celem związanym z bezpieczeństwem była ochrona ludzi

i budynku.

Lata ’ 90 i początek nowego millenium- ’00 to większe skupienie uwagi m.in. na unikaniu przypadkowego zalania sprzętu, co przełożyło się na rozbudowę takich systemów o detekcję pożaru- system wymagał wykrycia pożaru np. przez czujniki dymu, przed uruchomieniem zraszaczy. To wtedy do powszechnego zastosowania weszły systemy ASD- wczesnego wykrywania dymu, pomimo, że sam system opracowano już w latach ’80.

Kolejne lata to wprowadzanie na rynek systemów opartych o gazy obojętne czy gazy czyste technicznie, które przede wszystkim nie niszczą sprzętu i gaszą pożar poprzez obniżenie poziomu tlenu w pomieszczeniu. To jednak ciągle nie wystarczało. Zaczęto kłaść coraz większy nacisk na jak najwcześniejszą detekcję pożaru, nawet już na poziomie samej szafy. Obecnie standardem staje się podejście wielopoziomowe, obejmujące:

- bardzo wczesną detekcję (ASD o wysokiej czułości),

- detekcję lokalną (np. wewnątrz samych rack-ów),

- integrację z systemami np. FAS, BMS i DCIM,

- redundancję systemów detekcji i gaszenia,

- szybkie, precyzyjne systemy gaszenia dopasowane do konkretnej strefy.

Nasuwa się pytanie- gdzie w tym wszystkim jest miejsce na wentylację pożarową i jej rolę w data center?

Bezpieczeństwo i rola wentylacji pożarowej

Klasyczna funkcja wentylacji pożarowej to oddymianie i obniżenie temperatury, stosowana przede wszystkim po to, aby umożliwić ewakuację ludzi oraz działanie służb ratunkowych. To był, jest i powinien być priorytet działania takich systemów. Jednak w przypadku DC dochodzi również funkcja kontrolna. Poprzez kontrolowanie przepływu powietrza podczas pożaru, systemy wentylacji pożarowej wspierają systemy detekcji i gaszenia w taki sposób, aby nie wpływać negatywnie na skuteczność tych systemów np. poprzez rozcieńczenie środka gaśniczego lub zbyt szybkie usunięcie go ze strefy pożaru. Co więcej- dopiero po ugaszeniu zagrożenia- dochodzi do kontrolowanego przewietrzenia pomieszczenia. To wszystko sprawia, że wentylacja pożarowa nie jest osobnym „bytem” i nie działa jako autonomiczny system, tylko stanowi część większego, zintegrowanego systemu łączącego m.in. systemy wczesnej detekcji, systemy gaszenia, HVAC itp. Celem takiej integracji jest współpraca systemów w scenariuszach pożarowych, by zminimalizować wpływ dymu i ognia na ciągłość działania DC. Warto dodać, że już na etapie projektowania wentylacji pożarowej w DC, należy uwzględnić specyfikę tego typu obiektów i współdziałanie

z innymi systemami. W centrach danych, szczególnie w tych o klasie TIER III / IV, system wentylacji pożarowej musi działać nawet w przypadku awarii pojedynczego elementu, aby chronić ludzi i sprzęt oraz wspierać ciągłość działania. Podobne wymagania dotyczą niezawodności i redundancji systemów wentylacji pożarowej w normie EN 12101, która określa ogólne zasady projektowania oddymiania dla wszystkich typów budynków.

Chociaż wentylacja pożarowa nie jest wymieniona wprost w ustawie o infrastrukturze krytycznej, w specyfice centrów danych, szczególnie klasy TIER III/IV, jej funkcja czyni ją krytycznym elementem systemu, niezbędnym dla bezpieczeństwa i ciągłości działania. Z handlowej perspektywy często spotykam się z przekonaniem, że wentylacja pożarowa służy wyłącznie spełnianiu wymogów prawnych i norm. Jednak zmiana perspektywy i traktowanie wentylacji pożarowej jako integralnej części infrastruktury krytycznej, pozwala nie tylko skutecznie chronić ludzi

i sprzęt, ale także zwiększać niezawodność i ciągłość działania centrum danych, a nawet zwiększyć wartość biznesową całego obiektu.

Rola Mercor Light & Vent sp. z o.o. w ochronie data center

Mercor od lat aktywnie uczestniczy w budowie centrów przetwarzania danych, zarówno dla małych jak i dużych graczy tzw. „ hiperskalerów”, poprzez wsparcie w projektowaniu, oraz dostarczeniu urządzeń. Już od samego etapu projektowania, np. poprzez symulacje CFD pomagamy klientom właściwie rozplanować

i dobrać poszczególne urządzenia lub systemy. Uwzględniając systemy chłodzenia i wentylacji, jesteśmy w stanie przewidzieć zachowanie dymu podczas pożaru. Na tym etapie często pojawia się pytanie: jak rozwiązać konflikt między wysokimi przepływami powietrza,

a potrzebą ograniczenia transportu dymu i utrzymania środka gaśniczego? W rozwiązaniu m.in. takiego problemu u klienta- nasi projektanci służą pomocą

i wsparciem.

Oprócz wsparcia projektowego dostarczamy:

- klapy przeciwpożarowe - np. mcr WIP PRO, których zadaniem jest odcinanie stref pożarowych, kontrola rozprzestrzeniania się dymu i gorących gazów oraz współpraca z wentylatorami oddymiającymi

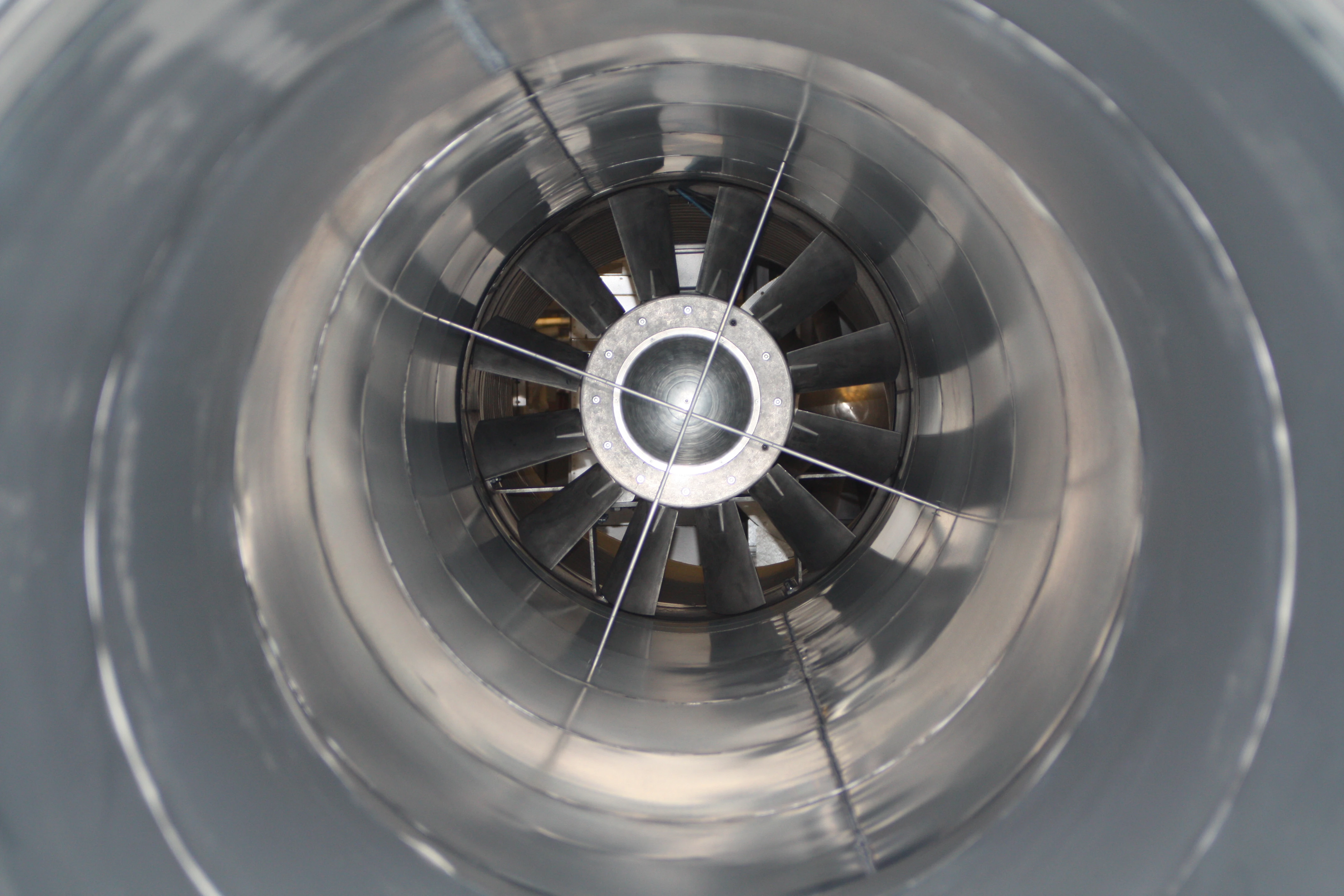

i systemami gaśniczymi. Wszystkie klapy oddymiające Mercor są również przeznaczone do systemów gaśniczych z gazami obojętnymi, a ich konstrukcja jest przystosowana do pracy w wysokiej temperaturze zgodnie z klasyfikacją wyrobów pożarowych podaną w DTR, - wentylatory oddymiające i napowietrzające (np. mcr MONSUN-T), które w data center wspierają: utrzymanie warunków umożliwiających bezpieczną ewakuację, ograniczenie oddziaływania wysokiej temperatury na infrastrukturę techniczną, realizację scenariuszy pożarowych dla stref o wysokiej gęstości urządzeń IT,

- centrale zasilająco-sterujące mcr Omega PRO, które są kluczowym elementem systemów bezpieczeństwa pożarowego w data center. Z jednej strony zapewniają odpowiednie zasilanie, z drugiej zaś pozwalają wysterować i zintegrować pracę klap

i wentylatorów z innymi systemami – HVAC, FAS,BMS czy DCIM, w zależności od scenariusza pożarowego.

Podsumowanie

Centra danych to dziś kluczowy element funkcjonowania nowoczesnego świata – swoiste „serce cyfrowej gospodarki”, gdzie bezpieczeństwo, niezawodność i szybka reakcja na zagrożenia są fundamentem stabilności. Dynamiczny rozwój technologii, szczególnie w obszarze AI, generuje zarówno ogromne inwestycje, jak i rosnące wyzwania związane z zapotrzebowaniem na moc obliczeniową, chłodzenie oraz ochronę przed pożarem. Każdy element infrastruktury DC, od pojedynczych racków po zintegrowane systemy monitorujące i zarządzające, musi być projektowany z myślą o ciągłości działania i odporności na ryzyko. Właśnie dlatego kompleksowe podejście, łączące normy, nowoczesne technologie oraz doświadczenie partnerów, takich jak Mercor Light & Vent, staje się kluczowe dla zapewnienia bezpieczeństwa i niezawodności w centrach danych. Wspólne działania branży

i innowacyjne rozwiązania sprawiają, że możemy być spokojni o przyszłość naszych „fabryk danych”, nawet w obliczu wyzwań, które dopiero nadejdą.

Piotr Życki,

Specjalista ds. Eksportu,

pion Systemów Wentylacji Pożarowej Mercor Light&Vent sp. z o.o.

źródła:

[II] https://www.statista.com/statistics/738977/worldwide-monthly-data-traffic-per-smartphone/

[IV] https://www.mckinsey.com/industries/technology-media-and-telecommunications/our-insights/ai-power-expanding-data-center-capacity-to-meet-growing-demand

[VI] https://www.iea.org/reports/energy-and-ai/executive-summary

[IX] https://corporate.ovhcloud.com/sites/default/files/2021-12/ovh-groupe-urd-2021-eng-vdef_0.pdf

[X] https://itwiz.pl/polski-rynek-data-center-potroi-zasoby-mocy-do-2030-roku

[XI] K. Kaczorek-Chrobak, Fire properties of electric cables used in buildings, ITB, 2023